IA en entreprise : les trois décisions que seul le dirigeant peut prendre

Pourquoi la plupart des stratégies IA échouent à créer de la valeur, et ce que cela exige du dirigeant

La moitié des PDG estiment que leur poste est en jeu si l'IA ne produit pas de résultats concrets en 2026, selon une étude BCG publiée cette année. Les budgets IA doublent (de 0,8 % à 1,7 % du chiffre d'affaires en moyenne), les preuves de concept se multiplient, mais les retours mesurables restent marginaux. Le problème n'est ni technologique, ni budgétaire. Il est décisionnel. Trois arbitrages critiques déterminent si un déploiement IA générera de la valeur ou consumera des ressources sans impact. Et ces trois arbitrages ne peuvent pas être délégués à la DSI, au CDO ou à un prestataire externe. Ils relèvent du dirigeant, parce qu'ils engagent la stratégie, l'identité et la gouvernance de l'entreprise.

Cet article détaille ces trois décisions, les erreurs les plus fréquentes observées dans les organisations, et les cadres concrets pour les trancher.

Première décision : où déployer l'IA (et surtout, où ne pas la déployer)

Le piège du déploiement généralisé

L'erreur la plus coûteuse consiste à répandre l'IA sur l'ensemble des processus métier. C'est l'équivalent organisationnel de poser un filet de sécurité sur toute une montagne : techniquement possible, économiquement ruineux, et opérationnellement contre-productif. Le coût de maintenance, de supervision et de correction des erreurs dépasse rapidement les gains espérés. Forrester le confirme dans son analyse de 2026 : l'IA reste coincée en « mode efficacité » dans la majorité des organisations. Les directions technologiques, incitées à optimiser les coûts, livrent des gains de productivité incrémentaux sans transformation réelle. Plus préoccupant encore, les partenaires métier ne parviennent pas à articuler ce qu'ils attendent de l'IA au-delà de la réduction de coûts.

Le dirigeant qui délègue la décision du « où » à l'IT obtient mécaniquement une stratégie centrée sur l'efficience, pas sur la valeur.

Le cadre décisionnel : le déploiement chirurgical

La question stratégique n'est pas « comment déployer l'IA sur tout mon process ? » mais « quel problème précis l'IA peut résoudre là où elle diminuera les erreurs et amplifiera ce qui fait ma valeur distinctive ? ». L'analogie la plus opérante est celle du filet de sécurité ciblé. Un filet posé au bon endroit protège un passage critique sans alourdir l'ensemble de l'infrastructure. Un filet posé partout transforme la montagne en chantier permanent.

Concrètement, le dirigeant doit identifier les nœuds de friction dans la chaîne de valeur : là où l'erreur humaine coûte cher, là où la répétition détruit de la compétence, là où le temps de traitement crée un désavantage concurrentiel. Dans un réseau de distribution énergétique, ce n'est pas l'ensemble du service client qu'il faut automatiser, c'est le processus de récupération d'information réglementaire qui bloque la résolution au premier contact. Dans un cabinet comptable, ce n'est pas la relation client qu'il faut confier à une machine, c'est le processus de vérification normative qui génère des erreurs manuelles.

Le critère de décision est simple : l'IA doit être déployée uniquement là où elle permet à un collaborateur compétent de faire mieux ce qu'il sait déjà faire. Pas là où elle remplace une compétence absente. Un outil qui décuple une compétence existante produit de la valeur. Un outil qui compense une incompétence produit du bruit, parfois dangereux.

Implications concrètes pour le comité de direction

Avant chaque validation de projet IA, le dirigeant devrait exiger trois réponses : quelle compétence métier existante ce déploiement va amplifier ? Quel indicateur de performance spécifique sera impacté ? Et quel est le coût complet de supervision humaine du système déployé ? Si la troisième réponse dépasse le gain attendu, le projet ne tient pas.

Deuxième décision : ce que l'IA doit protéger (l'ADN de l'organisation)

La menace invisible : l'homogénéisation

Chaque entreprise possède ce que l'on pourrait appeler des « vertus sociales » implicites. Ce sont les comportements, les attitudes et les standards qui définissent son identité sur le marché. La rigueur absolue d'un cabinet d'audit. L'écoute empathique d'un réseau de soins. La réactivité brute d'une startup technologique. Ces vertus ne figurent dans aucun organigramme, mais elles déterminent la fidélité client et la cohérence interne.

L'IA mal déployée homogénéise ces vertus. Elle produit des réponses standardisées, des processus uniformisés, des interactions lissées. Le résultat : l'organisation perd progressivement ce qui la distingue de ses concurrents. Et la sanction du marché, elle, n'est pas standardisée. Elle est brutale et économique. Les clients ne pardonnent pas à une marque de devenir interchangeable.

Le cadre décisionnel : l'amplification identitaire

La bonne question pour le dirigeant n'est pas « comment l'IA va rendre mon organisation plus efficace ? » mais « comment l'IA va rendre mon organisation encore plus elle-même ? ». Si la vertu d'un comptable est la précision horlogère, l'IA doit permettre à ce comptable d'atteindre un niveau de précision impossible à la main. Si la vertu d'un commercial est l'intuition relationnelle, l'IA doit lui fournir une préparation de rendez-vous si complète que son intuition s'exerce sur un terrain mieux balisé.

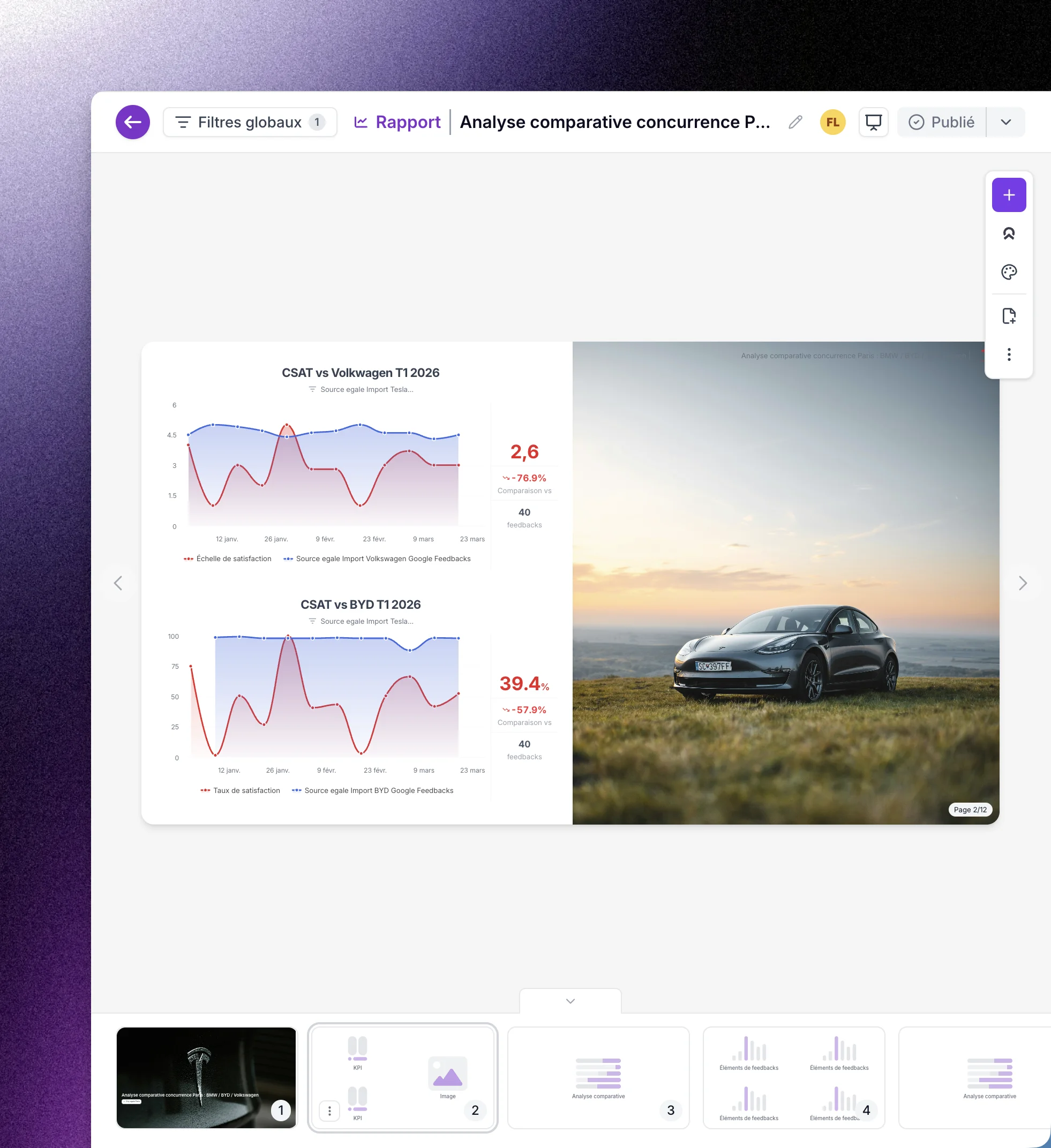

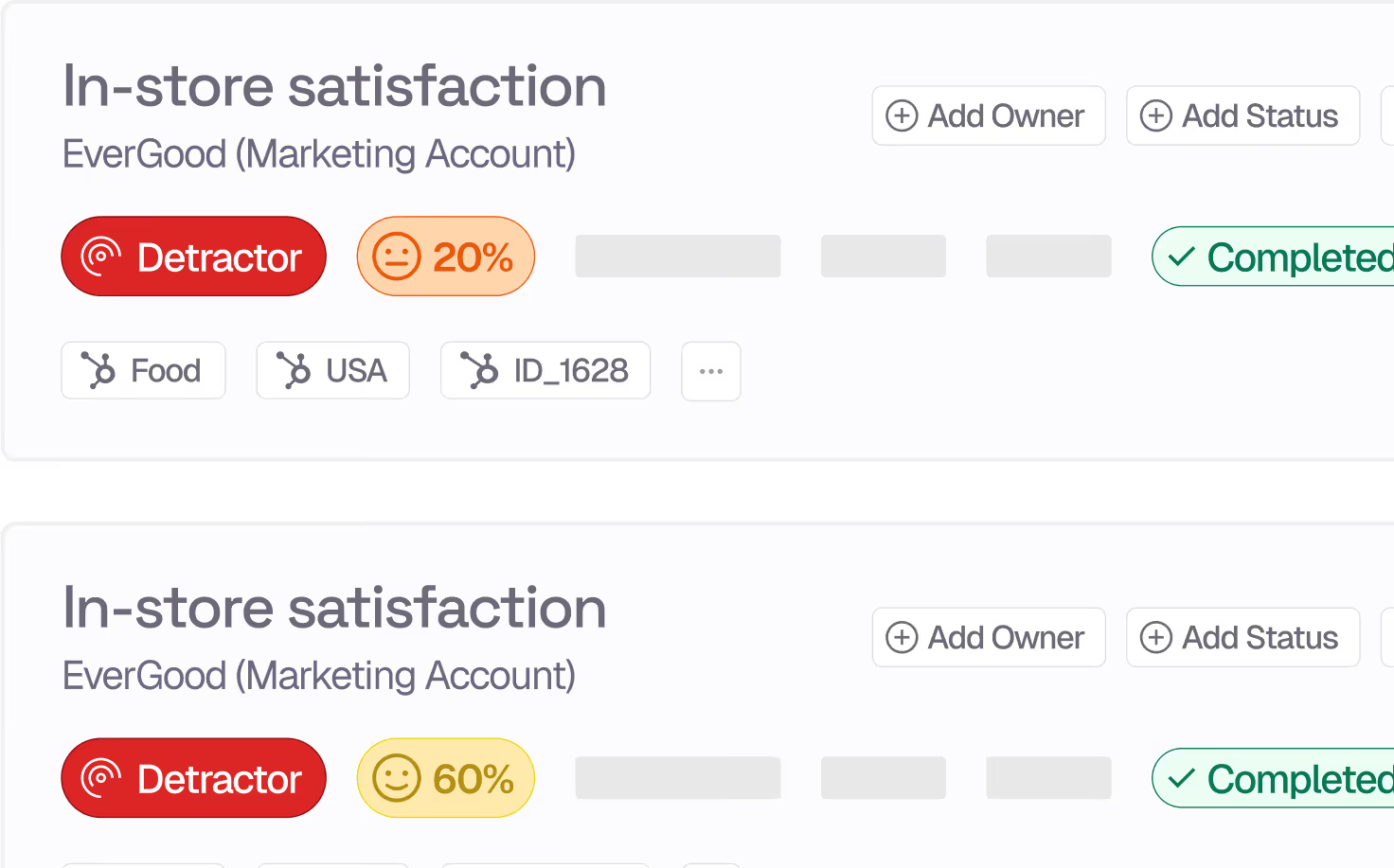

Ce renversement de perspective change tout le cadre de sélection des outils et des cas d'usage. Un outil qui standardise les interactions client dans un secteur où la personnalisation est la vertu cardinale n'est pas un gain d'efficacité : c'est une destruction de valeur à retardement. L'entreprise qui centralise ses retours clients avec des outils d'analyse sémantique ne le fait pas pour remplacer l'écoute humaine, mais pour donner aux équipes une vision plus complète de ce que les clients expriment réellement, afin que les décisions prises restent alignées avec la promesse de marque.

Implications concrètes pour le comité de direction

Le dirigeant doit formaliser, avant tout déploiement IA, les trois à cinq « vertus distinctives » de l'organisation. Ce ne sont pas des valeurs affichées sur un mur, ce sont les comportements concrets qui génèrent de la préférence client. Chaque projet IA doit ensuite être évalué sur un axe supplémentaire : ce déploiement amplifie, préserve ou érode cette vertu ? Si la réponse est « érode », même à la marge, le projet doit être reconfiguré ou abandonné.

Troisième décision : comment gouverner l'IA (le cadre éthique et opérationnel)

L'erreur de la charte sans gouvernance

La plupart des entreprises qui ont formalisé une politique IA se sont arrêtées à la rédaction d'une charte d'usage. C'est l'équivalent de rédiger un code de la route sans créer de permis de conduire, sans installer de radars, et sans prévoir de sanctions. La charte existe, personne ne la lit, et les usages divergent d'un département à l'autre.

Le problème est plus profond qu'une question de compliance. L'IA amplifie la responsabilité, elle ne la dilue pas. Plus un dirigeant dispose d'informations (et l'IA en fournit massivement), plus sa responsabilité augmente sur les décisions prises à partir de ces informations. « Je ne savais pas » cesse d'être une défense recevable quand l'outil était disponible et les données accessibles.

Le cadre décisionnel : la gouvernance par niveaux

L'analogie du permis de conduire est opérationnellement la plus féconde. Personne ne confierait une Ferrari à un conducteur qui vient d'obtenir son permis. De la même manière, l'accès aux outils IA devrait être progressif, conditionné par un niveau de compétence vérifié.

Trois niveaux concrets se dessinent dans les organisations matures. Le premier niveau correspond aux utilisateurs opérationnels : ils utilisent l'IA dans un cadre prédéfini, avec des garde-fous techniques (prompts verrouillés, outputs filtrés, validation humaine systématique). Le deuxième niveau correspond aux « réparateurs », les collaborateurs capables de diagnostiquer une erreur de l'IA, d'ajuster les paramètres et de former les utilisateurs de premier niveau. Le troisième niveau correspond aux « architectes », ceux qui conçoivent les workflows IA, définissent les cas d'usage et évaluent les risques systémiques.

Cette structuration ne crée pas de hiérarchie de prestige. Elle crée de la clarté. Un opérateur de premier niveau n'est pas inférieur à un architecte : il possède une compétence métier que l'IA amplifie. L'architecte possède une compétence technique que le métier oriente. La gouvernance sert à ce que chacun utilise l'outil à la hauteur de ce qu'il maîtrise.

Le « conseil des sages » : une instance de discernement

Au-delà des niveaux d'accès, les organisations qui réussissent leur déploiement IA créent une instance transverse de discernement. Pas un comité technique, pas un groupe de compliance, mais un espace où des profils expérimentés, conscients de la puissance de l'outil, évaluent les usages à l'aune de critères qui dépassent le ROI immédiat : impact sur la culture interne, risque réputationnel, cohérence avec la stratégie long terme.

Cette instance fonctionne sur un principe simple : ce n'est pas parce qu'on peut faire quelque chose qu'on doit le faire. La médecine a codifié ce principe en déontologie depuis des décennies. La chirurgie peut techniquement réaliser à peu près n'importe quelle intervention, mais la déontologie médicale pose des limites que le simple critère de faisabilité ne suffit pas à justifier. L'IA en entreprise mérite le même cadre.

Implications concrètes pour le comité de direction

Le dirigeant doit structurer trois éléments en parallèle : un système de niveaux d'accès (qui utilise quoi, et dans quel périmètre), un programme de montée en compétence (comment un collaborateur passe d'un niveau à l'autre), et une instance de discernement stratégique (qui évalue les cas limites et les nouveaux usages avant déploiement). Les trois doivent être opérationnels avant que le budget IA ne soit engagé massivement.

La responsabilité finale reste humaine

Le processus de décision en entreprise suit trois étapes que la philosophie morale a formalisées depuis des siècles : la délibération (rassembler l'information), la décision (trancher), et l'action (exécuter). L'IA excelle dans la première étape. Elle rassemble, croise, synthétise l'information à une vitesse et une échelle qu'aucun humain ne peut atteindre. Mais la deuxième étape, la décision, reste irréductiblement humaine. Décider, c'est assumer la responsabilité de l'acte. C'est pouvoir répondre à la question « pourquoi avez-vous fait ce choix ? » avec des raisons qui engagent une personne, pas un algorithme.

Le dirigeant qui automatise la délibération gagne du temps. Celui qui automatise la décision perd sa légitimité. La différence entre les deux n'est pas technique : elle est existentielle. Et c'est précisément parce qu'elle est existentielle que ces trois arbitrages ne peuvent pas être délégués.

Le guide ultime de la Voix du Client 2026

Nos articles pour aller

plus loin

Une sélection de ressources pour éclairer vos décisions CX et partager les approches que nous développons avec nos clients.