L'IA ne pense pas à votre place : pourquoi la compétence métier reste le vrai accélérateur de performance

L'intelligence artificielle n'est pas une intelligence. C'est un outil. Et comme tout outil, elle ne produit de valeur que si la personne qui l'utilise possède déjà la compétence qu'elle est censée amplifier. Toute entreprise qui déploie l'IA sans investir d'abord dans le savoir faire de ses équipes court le risque d'amplifier ses propres lacunes plutôt que de créer un avantage concurrentiel.

Le mot « artificiel » vient du latin artefactum : ce qui est fait de main d'homme. Un gobelet sert à boire. Une perceuse sert à percer. L'IA sert à produire du texte, de l'analyse, de la synthèse. La finalité de chacun de ces objets est inscrite dans sa conception. La véritable question à se poser face à l'IA n'est donc pas « est elle intelligente ? », mais « à quoi sert elle, et qui est compétent pour l'utiliser ? ». Ce recadrage change tout. Il replace l'humain au centre du processus et relègue la machine à ce qu'elle est : un amplificateur.

Artificiel ne veut pas dire intelligent

Dans l'expression « intelligence artificielle », le mot le plus important est « artificiel ». Il désigne ce qui est fabriqué par l'homme, pour l'homme, en vue d'une tâche définie. Les objets artificiels que nous produisons depuis des millénaires partagent tous cette caractéristique : ils décuplent une capacité humaine préexistante. La pince décuple la force de la main. Le télescope décuple la portée de l'œil. L'IA décuple la capacité de traitement textuel et analytique.

Ce que l'IA ne fait pas, en revanche, c'est penser. Le terme « intelligence » dans son appellation est avant tout un argument marketing. Il fait croire au grand public qu'une sorte de cerveau numérique serait capable de réfléchir, de juger, de décider de manière autonome. C'est une illusion. Un LLM (Large Language Model) est une machine à écrire automatique : un système capable de générer du texte en s'appuyant sur des probabilités statistiques. La nuance est fondamentale pour quiconque envisage d'intégrer l'IA dans un processus opérationnel, stratégique ou créatif.

La philosophie pose cette distinction depuis des siècles. La computation n'est pas la pensée. Des philosophes comme Searle et Fodor l'ont démontré : associer des éléments matériels dans une chaîne logique produit du calcul, pas de la conscience. L'esprit humain opère par intentionnalité, par variation, par implication personnelle dans le raisonnement. L'IA, elle, opère par corrélation statistique. Confondre les deux, c'est bâtir sa stratégie sur un malentendu.

Sans compétence de base, l'IA ne décuple rien

Prenons une métaphore concrète. Une bétonneuse est un outil extraordinaire pour monter un mur. Elle mélange le ciment, le sable et l'eau avec une efficacité que la main humaine ne peut égaler. Pourtant, si vous ne savez pas monter un mur (proportions du mélange, épaisseur des joints, hauteur du soubassement), la bétonneuse ne vous sera d'aucune utilité. Pire : elle vous permettra de gaspiller des ressources plus vite.

L'IA fonctionne exactement de la même manière. Un professionnel compétent qui utilise l'IA verra sa productivité décuplée. Un collaborateur qui ne maîtrise pas son sujet obtiendra un résultat plus rapide, certes, mais fondamentalement médiocre. Selon Gartner, d'ici 2026, l'atrophie des capacités de pensée critique liée à l'usage de l'IA générative poussera 50 % des organisations mondiales à exiger des évaluations de compétences « sans IA ». Cette prédiction illustre un phénomène que toute direction générale devrait anticiper : la dépendance à l'outil peut éroder le socle de compétences qui en justifiait l'adoption.

L'analogie culinaire est tout aussi parlante. Un pâtissier expérimenté sait monter une crème fouettée à la main. Il connaît la texture, le point d'arrêt, la consistance idéale. Le jour où il utilise un robot, il obtient un résultat parfait en deux fois moins de temps. En revanche, un novice qui lance le robot sans cette connaissance préalable transformera sa crème en beurre. L'IA, c'est ce robot : un accélérateur pour ceux qui savent, un piège pour ceux qui ne savent pas.

La conséquence pour les entreprises est directe. Avant de déployer l'IA sur un processus, il faut identifier la compétence spécifique que l'outil va décupler chez chaque collaborateur. Cette cartographie des compétences est un prérequis, pas une option.

Penser ne se réduit pas à calculer : la méthode et la data

Descartes ouvre son Discours de la méthode par une phrase célèbre et largement mal interprétée : « Le bon sens est la chose du monde la mieux partagée. » La plupart y voient un compliment. C'est en réalité une ironie. Descartes constate que tout le monde se croit doté de bon sens, que personne ne réclame jamais d'en avoir davantage, et que pourtant les erreurs de jugement sont universelles. Pourquoi ? Parce que le bon sens brut ne suffit pas. Il faut une méthode.

Cette observation résonne avec une acuité particulière à l'ère de l'IA. Beaucoup d'utilisateurs pensent savoir utiliser un outil comme ChatGPT ou Claude parce qu'ils savent taper une question. C'est l'équivalent de croire qu'on sait cuisiner parce qu'on sait allumer un four. Pour tirer de la valeur d'une IA, il faut réunir deux conditions : une méthode de pensée structurée et des données fiables. La méthode, c'est le cadre intellectuel qui permet de poser les bonnes questions, de hiérarchiser les informations, de distinguer le probable du vraisemblable. La data, c'est le matériau brut sur lequel la méthode s'exerce.

L'IA fonctionne par probabilité. Plus le contexte fourni est précis et les données abondantes, plus le résultat s'approche de la réalité. Lui demander « c'est quoi une vie bonne ? » ne mènera nulle part. Lui fournir un contexte serré avec des données massives sur un sujet spécifique produira une synthèse exploitable. La qualité du prompt reflète la qualité de la pensée de celui qui le rédige. L'IA est un miroir : elle renvoie une image amplifiée de ce qu'on lui donne.

Penser, c'est donc bien plus que calculer. C'est viser quelque chose (l'intentionnalité), c'est faire varier les perspectives pour saisir l'essence d'un problème, c'est s'impliquer personnellement dans le raisonnement. Un article de la Harvard Business Review qualifie de « dataïsme » la croyance naïve selon laquelle accumuler toujours plus de données et les confier à des algorithmes toujours plus puissants suffirait à découvrir la vérité et à prendre les bonnes décisions. C'est précisément cette croyance qu'il faut combattre dans les organisations.

L'intentionnalité et la responsabilité de la décision

Thomas d'Aquin, au XIIIe siècle, a théorisé le processus de décision morale en trois étapes : délibération, décision, action. Dans la phase de délibération, l'individu rassemble le maximum d'informations pour identifier le bien et les moyens de le réaliser. C'est dans cette phase que l'IA excelle. Elle peut parcourir des milliers de documents, croiser des sources, proposer des synthèses. Elle est, en quelque sorte, le meilleur conseiller qu'un décideur puisse consulter.

La décision, en revanche, reste un acte irréductiblement humain. Décider, c'est assumer la responsabilité de son choix. C'est pouvoir répondre à la question « pourquoi as tu fait ça ? ». L'IA peut éclairer la délibération, elle ne peut pas porter la responsabilité. Automatiser le processus décisionnel complet via des workflows qui enchaînent IA et exécution sans intervention humaine pose une question éthique fondamentale. Chaque décision automatisée est une responsabilité non assumée.

Ce cadre philosophique a des implications très concrètes en entreprise. L'IA augmente la responsabilité du décideur plutôt qu'elle ne la diminue. Puisque l'outil permet d'accéder à plus d'informations, plus vite, l'argument de l'ignorance (« je ne savais pas ») perd toute légitimité. Le dirigeant qui dispose d'un outil capable de scanner l'ensemble de la réglementation applicable ne peut plus invoquer la méconnaissance. L'IA élargit le champ de vision et, ce faisant, elle élargit le périmètre de ce dont chacun est comptable.

L'intuition professionnelle conserve par ailleurs un rôle irremplaçable. Un commercial qui sort d'une réunion et « sent » que la négociation va échouer ne s'appuie sur aucun document, aucune donnée structurée. Il s'appuie sur des années d'expérience incarnée. Cette intelligence situationnelle, ce « feeling » forgé par la pratique, est précisément ce que l'IA ne peut ni reproduire ni remplacer. L'IA apporte de l'information. L'humain apporte du jugement.

Former à l'IA, c'est d'abord former à penser

La question de la formation est centrale. Trop d'organisations réduisent la montée en compétence IA à l'apprentissage du prompting. C'est comme si l'on formait des automobilistes uniquement au maniement du volant sans jamais aborder le code de la route, la mécanique ou la lecture du trafic.

Former à l'IA, c'est d'abord former à penser. C'est développer chez chaque collaborateur la capacité à structurer un raisonnement, à distinguer une corrélation d'une causalité, à identifier les biais dans un résultat généré. C'est aussi cultiver ce que la philosophie appelle l'esprit critique : savoir quand arrêter la machine, savoir reconnaître qu'un output est séduisant mais faux, savoir que la fluidité d'un texte ne garantit pas sa pertinence.

La métaphore du permis de conduire est éclairante. Personne ne confierait une Ferrari à un conducteur qui vient d'obtenir son permis. Le nombre de cylindres est limité, la puissance est bridée, la progression est encadrée. L'IA est une puissance phénoménale. Elle mérite le même type d'encadrement progressif. Cela signifie identifier, pour chaque collaborateur, le niveau de maîtrise actuel (utilisateur, réparateur, ingénieur, selon la typologie de Simondon) et calibrer l'accès à l'outil en conséquence.

Les entreprises qui se contentent de distribuer des licences ChatGPT à l'ensemble de leurs équipes sans former à la pensée critique commettent la même erreur que celles qui ont distribué des réseaux sociaux aux adolescents sans les préparer à l'exposition publique. La puissance sans la compétence ne produit pas de la performance. Elle produit du risque.

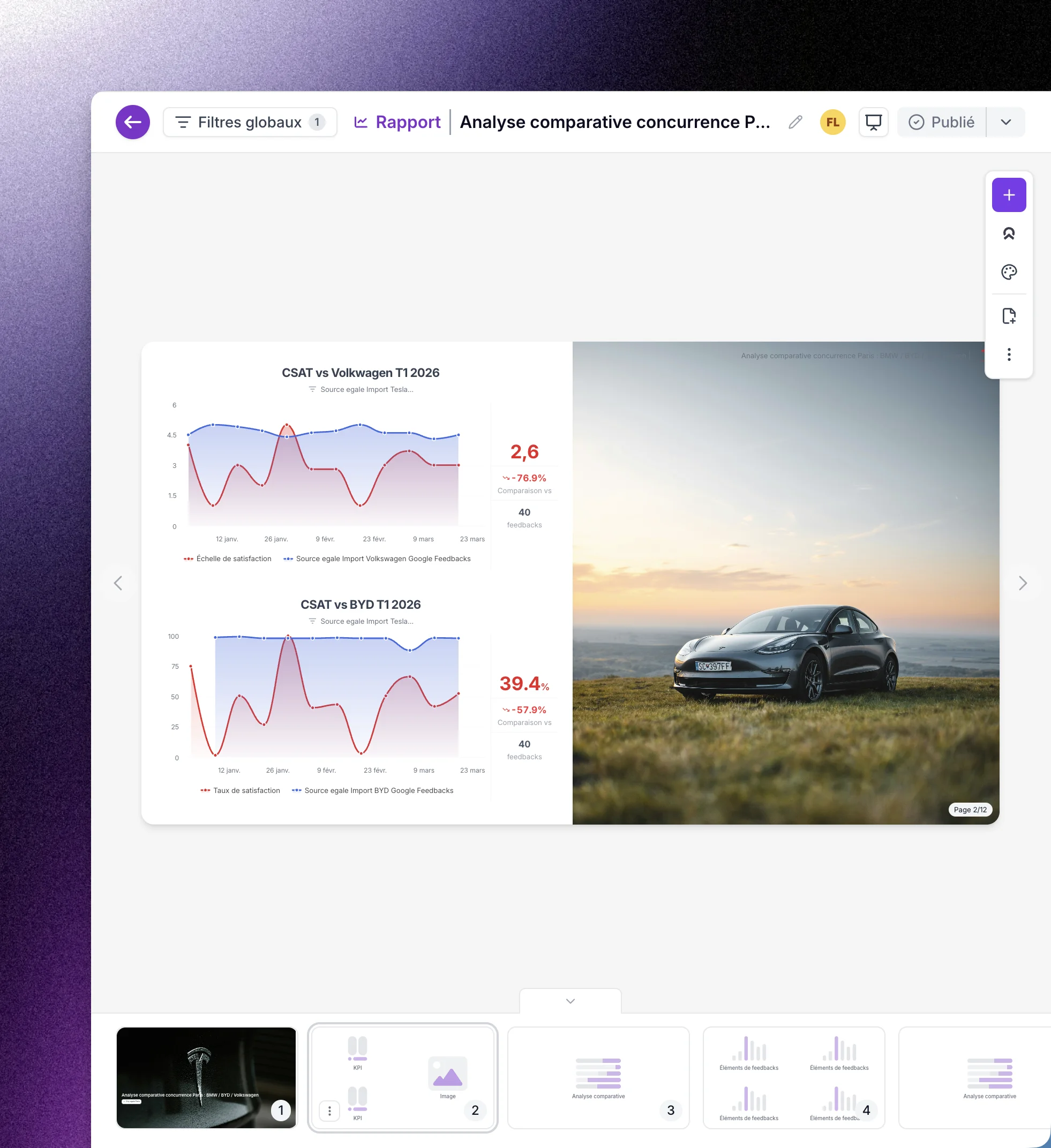

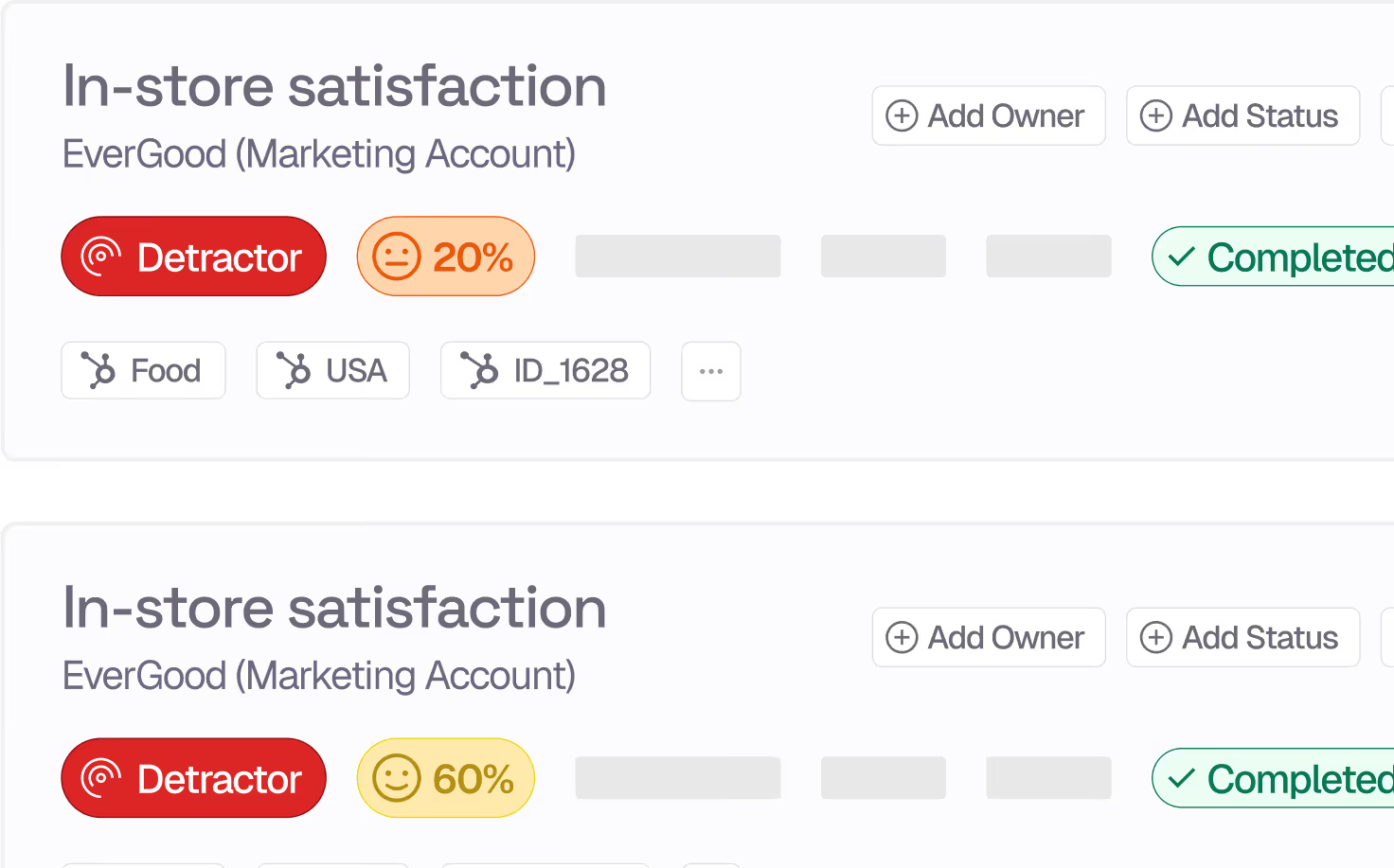

Concrètement, cela implique de repenser les parcours de formation en intégrant trois dimensions complémentaires. D'abord, la compétence métier : chaque collaborateur doit maîtriser son domaine avant d'y adjoindre l'IA. Ensuite, la méthode de pensée : savoir poser un problème, structurer une analyse, évaluer un résultat. Enfin, la maîtrise de l'outil : comprendre ce que l'IA fait réellement, ses limites probabilistes, et les contextes dans lesquels elle excelle ou échoue. Cette approche en trois couches transforme l'IA en ce qu'elle devrait toujours être : un accélérateur de compétences existantes, pas un substitut à la réflexion. L'analyse sémantique des retours clients, par exemple, ne prend tout son sens que lorsque l'analyste qui l'exploite comprend déjà les dynamiques de satisfaction et d'insatisfaction propres à son secteur.

L'IA ne remplacera pas les professionnels compétents. Elle rendra les incompétents plus visibles et les compétents plus performants. C'est à chaque organisation de décider dans quelle catégorie elle souhaite placer ses équipes.

Le guide ultime de la Voix du Client 2026

Nos articles pour aller

plus loin

Une sélection de ressources pour éclairer vos décisions CX et partager les approches que nous développons avec nos clients.